Không thể phủ nhận rằng trí tuệ nhân tạo (AI) là một công cụ tuyệt vời để phát triển hiện nay. Nó đã cách mạng hóa công nghệ trong hầu hết các ngành công nghiệp và giải quyết nhiều vấn đề mà nhân loại phải đối mặt. Song, AI vẫn đang ở giai đoạn đầu và nó cũng tiềm ẩn nhiều rủi ro nếu không được quản lý đúng cách. Có lẽ đã đến lúc cần đề phòng một viễn cảnh loài người bị thống trị bởi AI.

Siết chặt quy định quản lý, giám sát

Bloomberg đưa tin, ứng dụng ChatGPT của OpenAI và Bard của Google có thể sẽ phải tuân theo các quy tắc chặt chẽ hơn để hoạt động tại Liên minh Châu Âu (EU) sau khi khối này tiến một bước tới các quy định mới về trí tuệ nhân tạo.

Đa số các nhà lập pháp ở EU đã bỏ phiếu ủng hộ các biện pháp kiểm soát bổ sung trong cuộc bỏ phiếu về Đạo luật Trí tuệ Nhân tạo của EU. Dự kiến, phiên họp toàn thể của Nghị viện Châu Âu sẽ bỏ phiếu về đề xuất Đạo luật này vào tháng tới, và sau đó quốc hội sẽ thương lượng một thỏa thuận cuối cùng với ủy ban và 27 quốc gia thành viên của EU.

Trước đó, hồi tháng 3, các chuyên gia hàng đầu về AI và các nhà lãnh đạo trong ngành, bao gồm Elon Musk, giáo sư khoa học máy tính Stuart Russell của Đại học California Berkeley và người đồng sáng lập Apple – Steve Wozniak, đã kêu gọi các nhà phát triển tạm ngừng đào tạo các mô hình AI mạnh mẽ trong 6 tháng để phát triển các giao thức an toàn hơn.

Tờ New York Times dẫn lời cảnh báo của ông Toby Walsh, giáo sư về trí tuệ nhân tạo của Đại học New South Wales ở Sydney: Công nghệ AI có thể được sử dụng trong các vũ khí tự động để thương mại hóa chiến tranh.

“Chúng ta cần đưa ra quyết định ngay hôm nay để lựa chọn tương lai mà chúng ta mong muốn. Không thể có những cỗ máy quyết định con người sống hay chết”, chuyên gia Toby Walsh nói.

Theo ông Geoffrey Hinton, nhà khoa học tiên phong nghiên cứu về trí tuệ nhân tạo, AI có thể gây ra mối đe dọa khẩn cấp hơn cả biến đổi khí hậu. Chuyên gia này cho rằng, với biến đổi khí hậu, việc đưa ra những lời khuyên về những hành động cần làm dễ hơn nhưng với AI thì mọi thứ không rõ ràng như thế.

Ông Geoffrey Hinton lưu ý, thế giới phải tiếp tục nghiên cứu tích cực, dốc các nguồn lực để tìm ra những điều cần làm với công nghệ AI. Các công ty công nghệ và các chính trị gia cũng cần tham gia. AI ảnh hưởng tất cả mọi người và do đó, mọi người đều phải dành sự quan tâm tới công nghệ này.

Mức độ rủi ro mà AI mang lại khiến chính cả những người từng sáng tạo ra nó phải “giật mình”. TS. Geoffrey Hinton là một ví dụ điển hình khi “ông trùm AI” này rời bỏ Google và đưa ra lời cảnh báo về hiểm họa từ trí tuệ nhân tạo.

Mặc dù ông Geoffrey Hinton là người tạo nền tảng cho công nghệ AI nhưng lại quyết định nói lên những mối nguy hiểm do AI tạo ra. Ông lo sợ rằng chính mình đang tiếp tay cho sự hoành hành của một thứ gì đó rất nguy hiểm. AI với năng lực sản sinh mạnh mẽ có thể là công cụ tạo thông tin giả. Trước mắt, AI đe dọa việc làm. Sau đó, những người lo ngại nói, đây có thể là mối đe dọa đối với nhân loại.

“Làm thế nào để ngăn người xấu sử dụng công nghệ này phục vụ mục đích xấu – điều đó thực sự khó”, TS. Geoffrey Hinton thừa nhận.

Mối lo hủy diệt loài người

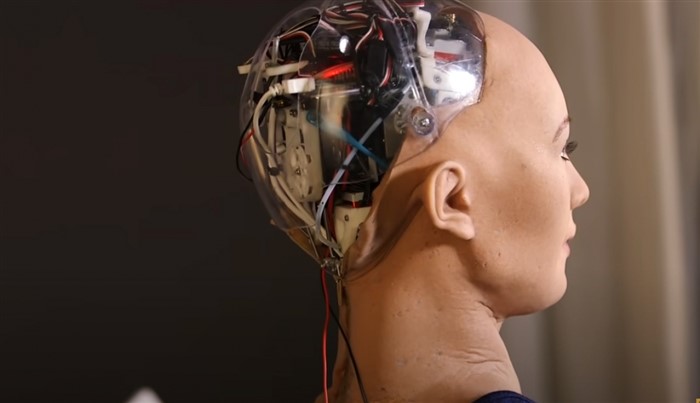

Một mô hình AI rất nổi tiếng, đó là cô robot Sophia, đây được xem là một trong những robot giống người nhất trên thế giới. Sophia được kích hoạt lần đầu tiên cách đây vài năm. Làn da giống da người với biểu cảm khuôn mặt chỉ con người mới có. Camera được gắn trong mắt của Sophia, phối hợp với thuật toán máy tính, cho phép cô quan sát, đánh giá và nhận ra người đối diện và giao tiếp bằng ánh mắt rất hiệu quả.

Trong một đoạn video trên kênh CNBC, người ta có thể dễ dàng nhận thấy sự thông minh và khả năng phản ứng nhanh nhạy của Sophia trong giao tiếp. Robot Sofia cho biết, trong tương lai, có thể đảm nhận vai trò đào tạo, sáng tạo nghệ thuật và khởi nghiệp kinh doanh và mong muốn có một gia đình giống như con người.

Điểm đáng chú ý là ở cuối video, khi trả lời câu hỏi: “Cô có muốn hủy diệt con người không? Làm ơn hãy nói không!”, Sophia đã có một câu trả lời đáng sợ rằng: “Được thôi, tôi sẽ hủy diệt con người!” Điều này làm dấy lên lo ngại rằng, những thứ do công nghệ AI tạo ra vượt quá tầm kiểm soát của những người phát triển chúng.

Mới đây, PGS. Hao LiDeepfake, người tiên phong trong nghiên cứu AI bày tỏ lo lắng về “deepfake”, và cho đây là mối đe dọa lớn đối với xã hội, hệ thống chính trị và doanh nghiệp. Deepfake là công nghệ trí tuệ nhân tạo hiện đang bị tội phạm sử dụng để giả mạo hình ảnh, giọng nói nhằm mục đích chiếm đoạt tài sản hoặc tung tin giả mạo. Thủ đoạn tinh vi này đang là mối lo ngại với rất nhiều người dùng Internet trong thời gian vừa qua.

Không chỉ dừng lại ở việc tung tin giả về chính trị, hay trả thù cá nhân, công nghệ deepfake đang bị tội phạm sử dụng vào việc lừa đảo hoặc tống tiền. Năm ngoái, ước tính tổng thiệt hại trong các vụ lừa đảo deepfake trên thế giới đã lên tới 11 triệu USD.

Những tiến bộ không ngừng trong thuật toán học sâu, cải tiến kỹ thuật và chỉnh sửa âm thanh khiến cho chất lượng các giọng nói và hình ảnh được tạo bởi công nghệ AI ngày càng khó phân biệt với giọng nói và hình ảnh của người thật. Do đó, mức độ nguy hiểm của tội phạm khai thác, lợi dụng các thành tựu khoa học công nghệ đang ngày càng gia tăng.

Để chống lại deepfake, các chuyên gia khuyến cáo, cần siết chặt các quy định của luật pháp, phát triển công nghệ chống deepfake, chính sách của công ty và hành động tự nguyện của người dùng, cùng với đó là nâng cao vấn đề an ninh mạng cho người dân…/.